《AI+硬件 2035: 重塑下一个十年》

这篇题为《AI+HW 2035: Shaping the Next Decade》的论文,由来自UIUC、UCLA、Stanford、NVIDIA、Google、IBM Research、OpenAI、AMD等近三十家顶级机构的研究者联合撰写,是一份NSF资助研讨会的成果产出。作者阵容堪称豪华——Yann LeCun、Anima Anandkumar、Azalia Mirhoseini、Tri Dao等人均在列,这在一定程度上赋予了文章相当的权威性。

文章的核心论点是:AI与硬件的发展已经深度交织,但两者之间存在严重的协同断层。算法以月为单位迭代,硬件以年为单位演进;AI模型假设静态后端,而芯片却在为已经过时的模型做优化。这种错位正在以系统性的方式制约整个领域的进步。

三层协同演进框架

论文提出了一个三层抽象架构,这是整篇文章的理论骨架:

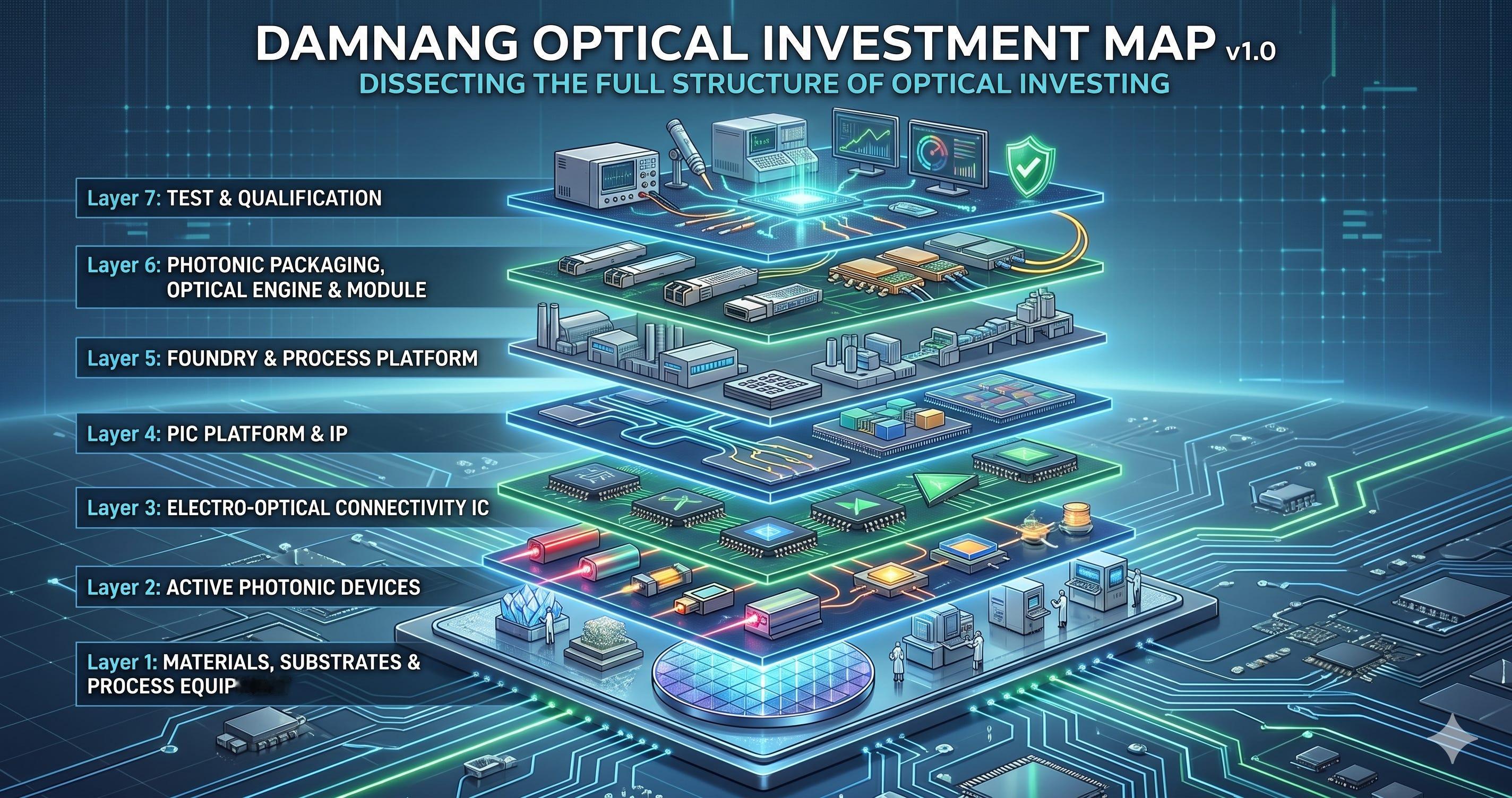

硬件层(Hardware Layer) 是物理基础,定义了AI系统的性能上限。文章着重指出,当前计算架构的核心矛盾已经从"算力不足"转变为"数据搬运"问题——在大模型推理中,数据在内存层级之间移动所消耗的能量,已经远超实际计算本身。因此,近存计算(Near-Memory Computing)、存内计算(Compute-in-Memory)、3D异构集成、光子互连等技术被列为未来十年的核心突破方向。

算法层(Algorithm Layer) 的关键命题是"硬件感知的AI"与"AI自适应的硬件"需要双向融合。文章明确指出,Attention机制并非万能——SSM(状态空间模型)、扩散模型、稀疏架构等都有其不可替代的位置。更重要的是,文章强调了自优化系统的前景:模型生成优化后的计算核(kernels)、指导编译、持续改进硬件利用率,从而模糊AI模型、软件栈与硬件平台之间的边界。

应用层(Application Layer) 则将技术进步锚定在现实需求上。文章指出,到2035年,物理AI(Physical AI)——包括机器人、自动驾驶、工业控制——将占据真实世界推理任务的绝大多数份额。这类应用对实时性、能效和鲁棒性的要求极为苛刻,与云端训练场景有本质差异,必须作为独立的协同设计目标来对待。

核心技术洞察

从资深从业者的视角看,论文中有几个判断值得特别关注。

"Memory Wall"已经成为第一瓶颈。 这不是新观点,但文章将其系统化地贯穿于所有层次的分析中。HBM的演进、3D堆叠、CXL共享内存等方向被视为近期(2~5年)的核心投资,而更长期的光子互连和模拟计算则被定位为颠覆性但尚需突破的方向。训练与推理必须作为截然不同的协同设计目标。 这一判断在工业界已有共识,但论文将其上升到了体系结构设计原则的层面——推理,尤其是物理AI的推理,需要确定性响应、毫秒级延迟和极致能效,这与追求吞吐量的训练场景有根本性差异。

"小模型-大模型共生"生态。 论文预测,大模型将作为蒸馏来源和推理支架,而紧凑型SLM(小语言模型)将在边缘和嵌入式设备上高效运行。这与当前DeepSeek、Qwen等系列模型的实际发展趋势高度吻合。

AI驱动的EDA(电子设计自动化)将成为力量倍增器。 未来硬件系统的设计复杂度已经超越人工探索的边界,AI辅助的芯片设计——从RTL生成到布局布线再到验证——将把硅片设计周期从数年压缩到数月甚至数周。Azalia Mirhoseini在Nature上发表的芯片布局工作是这一方向的早期里程碑。

能源危机是最紧迫的非技术障碍。 文章毫不讳言地指出,美国数据中心的电力需求正在以数十吉瓦的速度增长,而电网容量远远跟不上。论文预测,若不采取行动,5年内将出现制约AI部署的电力短缺,并明确提出SMR(小型模块化反应堆)作为中期解决方案。

路线图目标与成功标准

论文设定的10年成功指标相当具体:AI训练和推理效率提升1000倍(分解为:算法优化10倍 × 硅利用率提升20倍 × 系统级效率提升5倍);集群持续利用率达到60%以上(目前普遍只有5~20%);异构系统实现无缝互操作;芯片设计周期缩短3倍以上,并实现可预测的PPA(功耗-性能-面积)指标。AI