[LG]《Haiku to Opus in Just 10 bits: LLMs Unlock Massive Compression Gains》R Rinberg, A M Carrell, S Henniger, N Carlini… [Harvard University & University of Cambridge] (2026)

在语言模型文本压缩领域,如何在信息论最优性与实际传输效率之间划定边界,始终是一个悬而未决的难题。过去的方法受困于"无损-有损"二元对立的框架,本质原因是将"传输完整响应"视为压缩的唯一目标,而忽视了语义等价的多种实现路径。

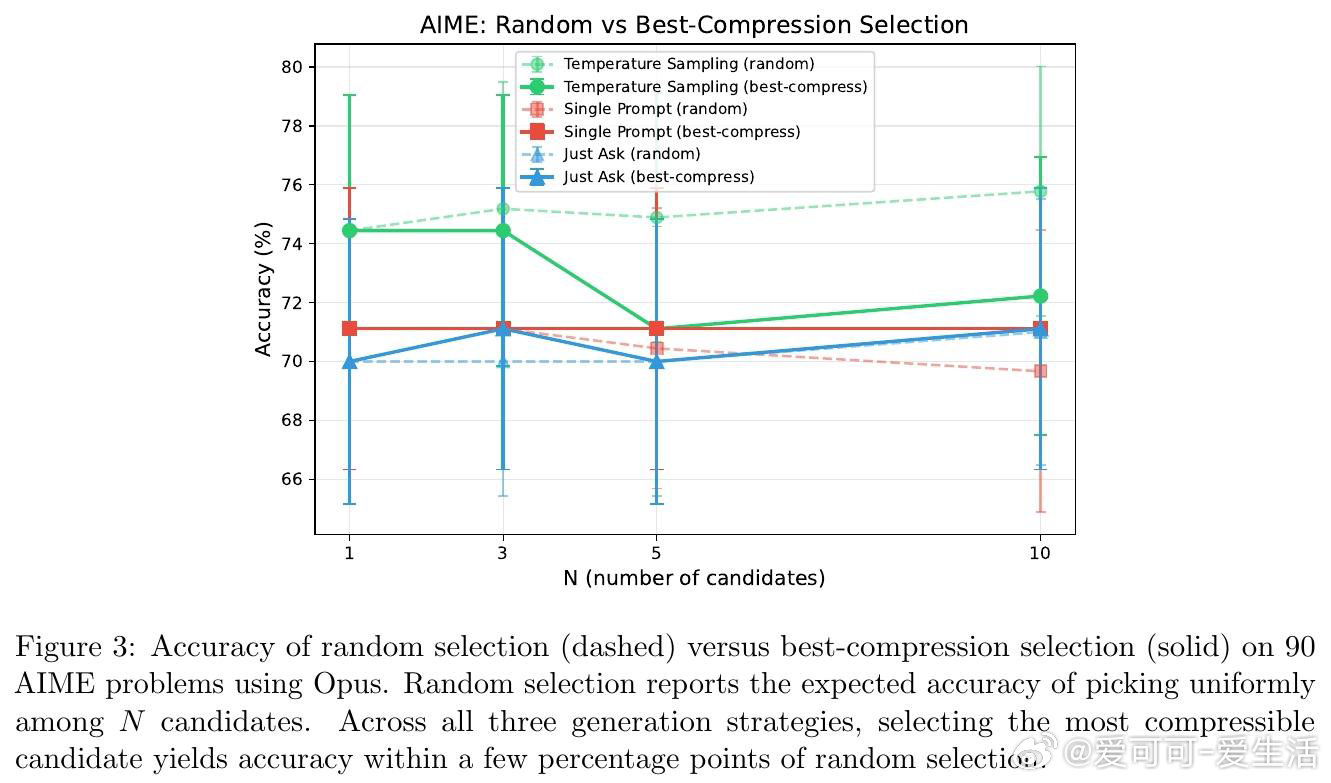

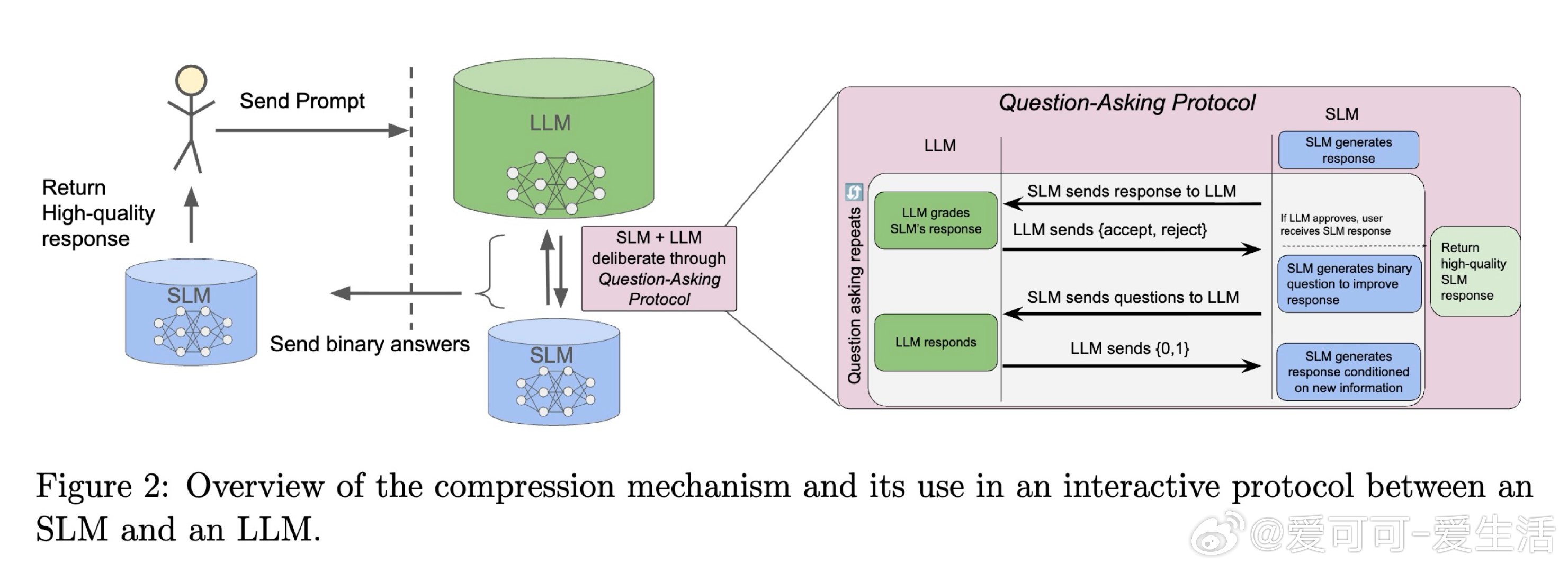

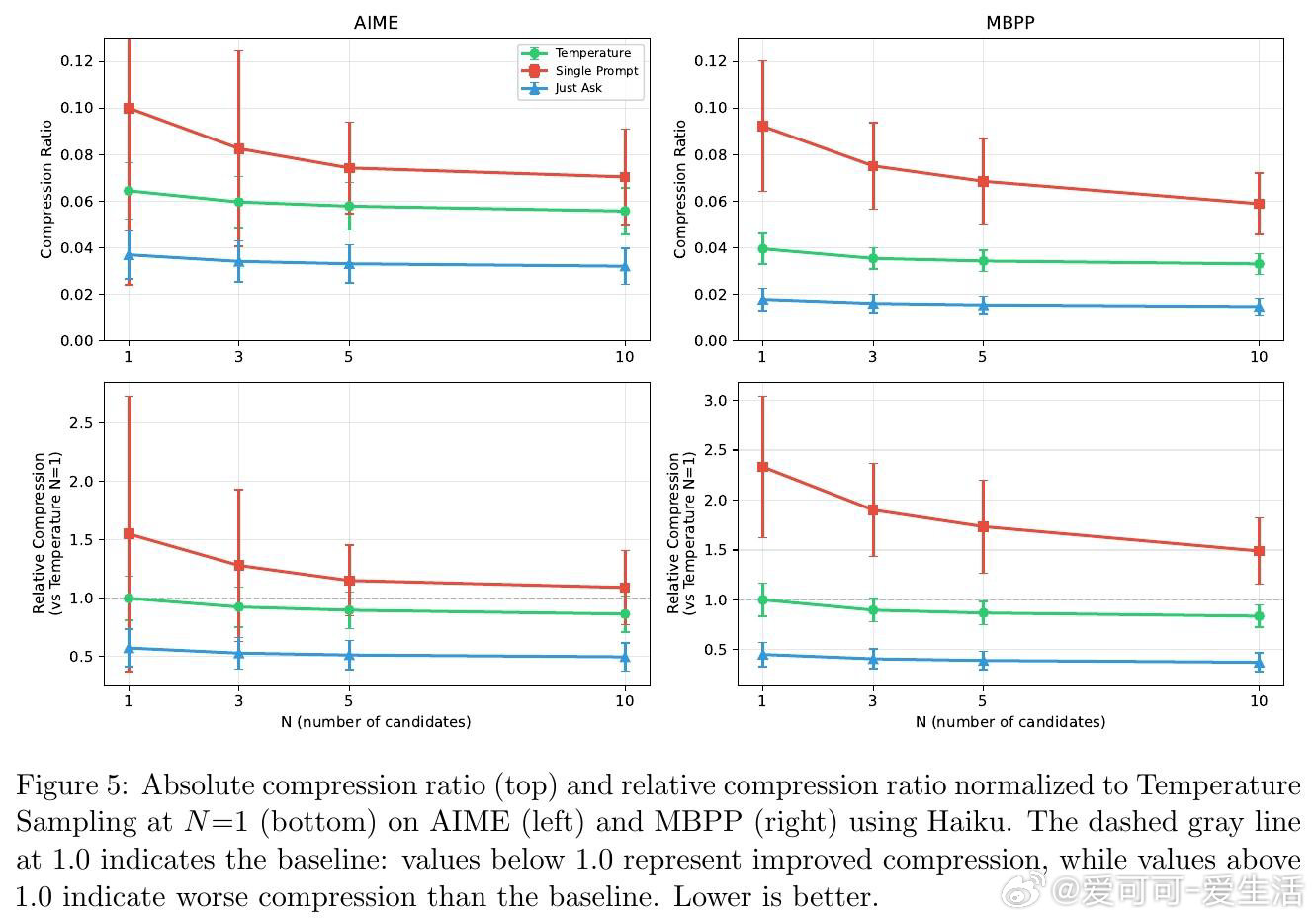

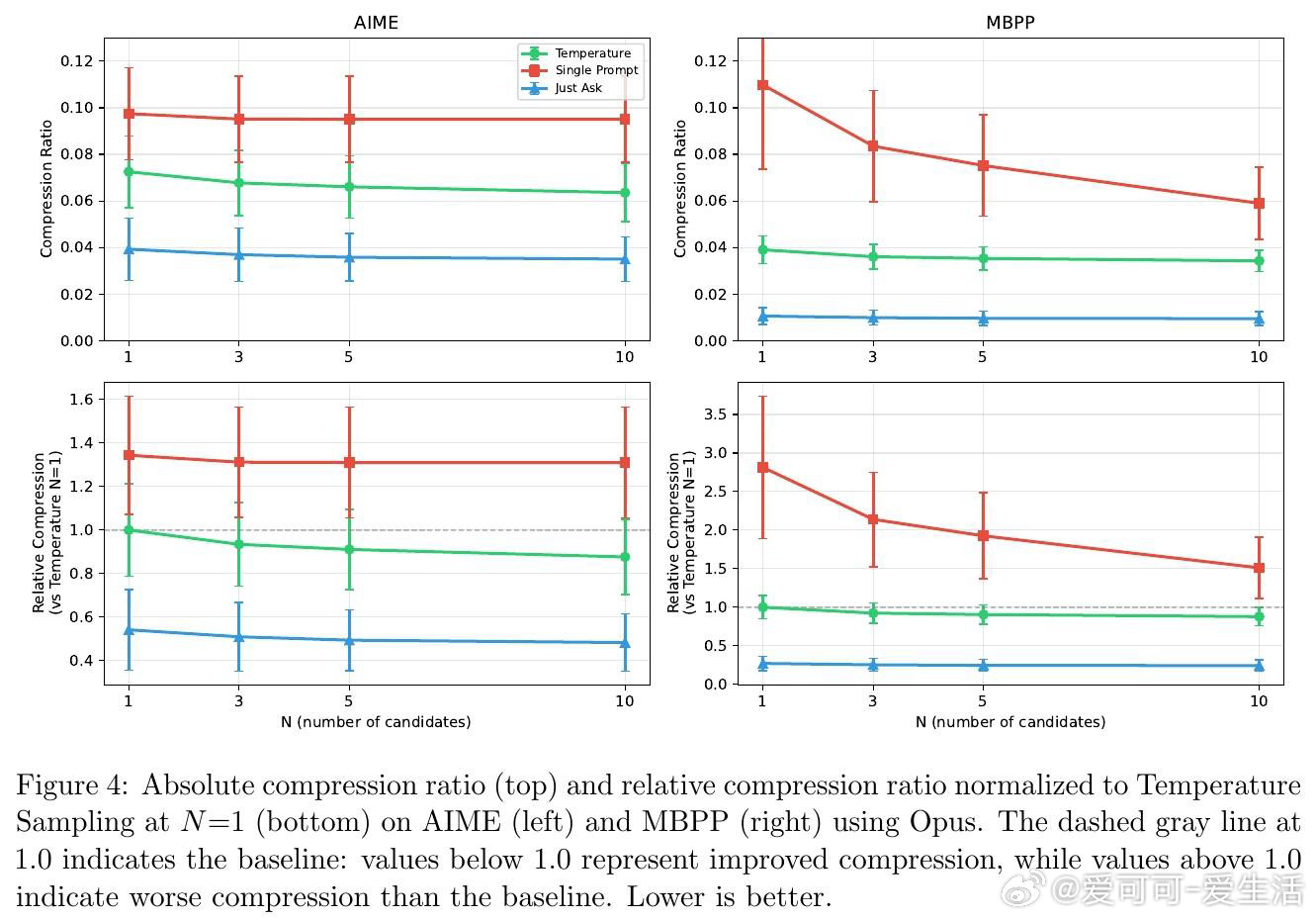

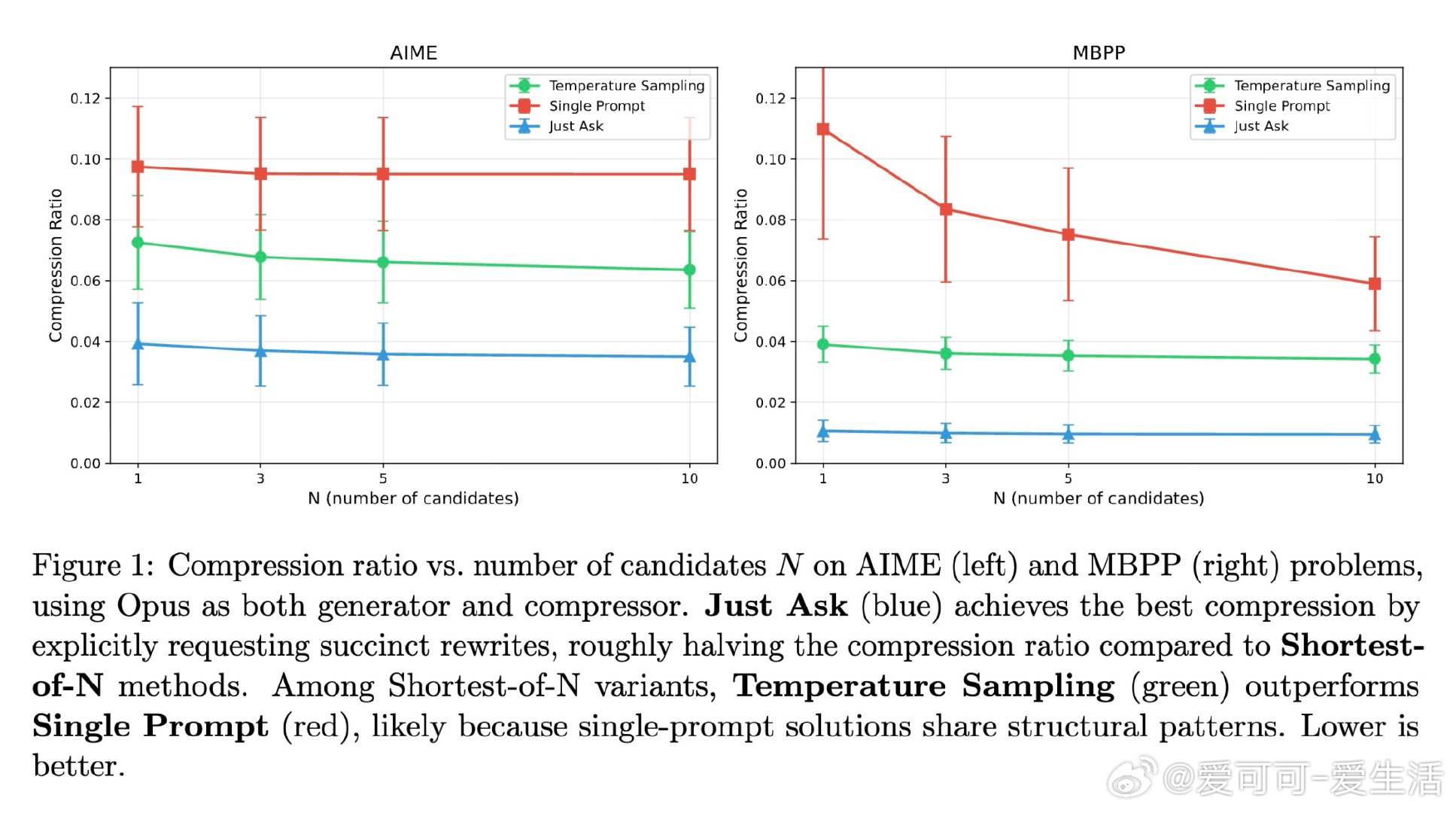

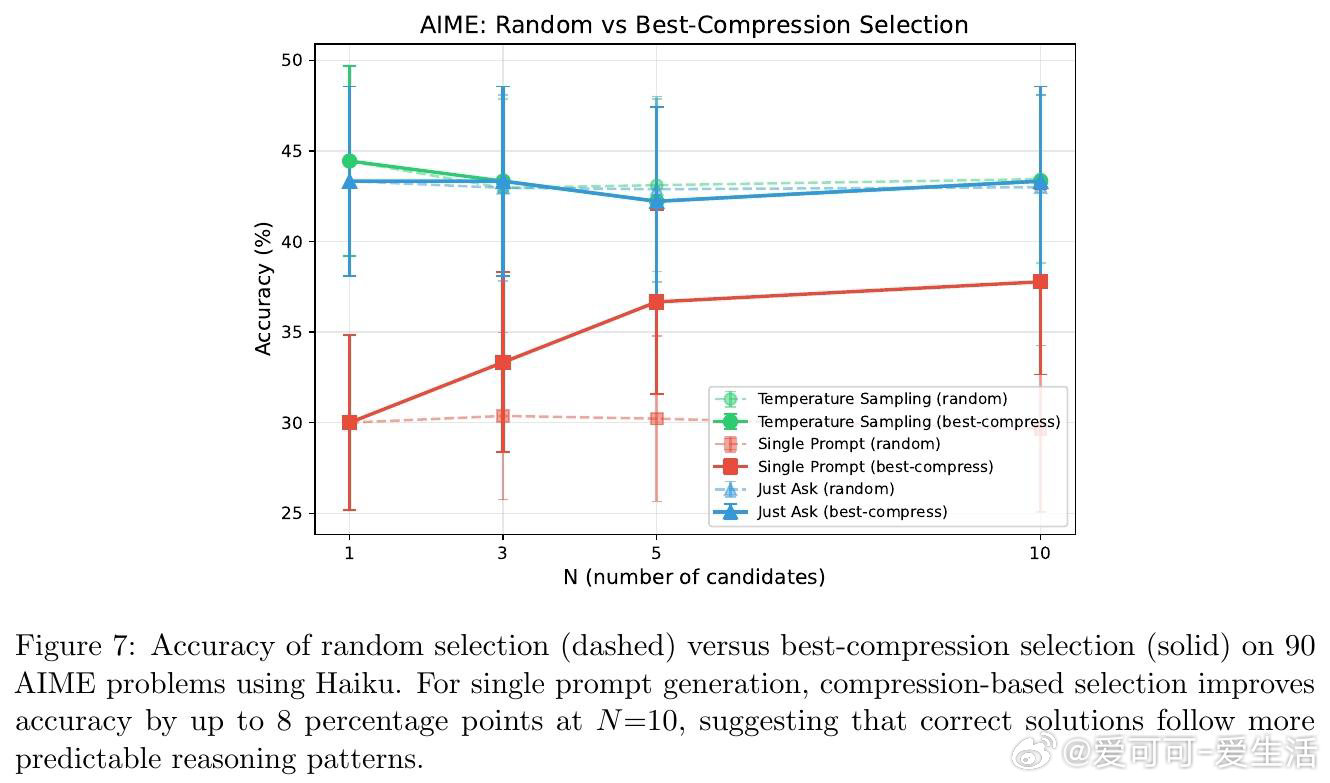

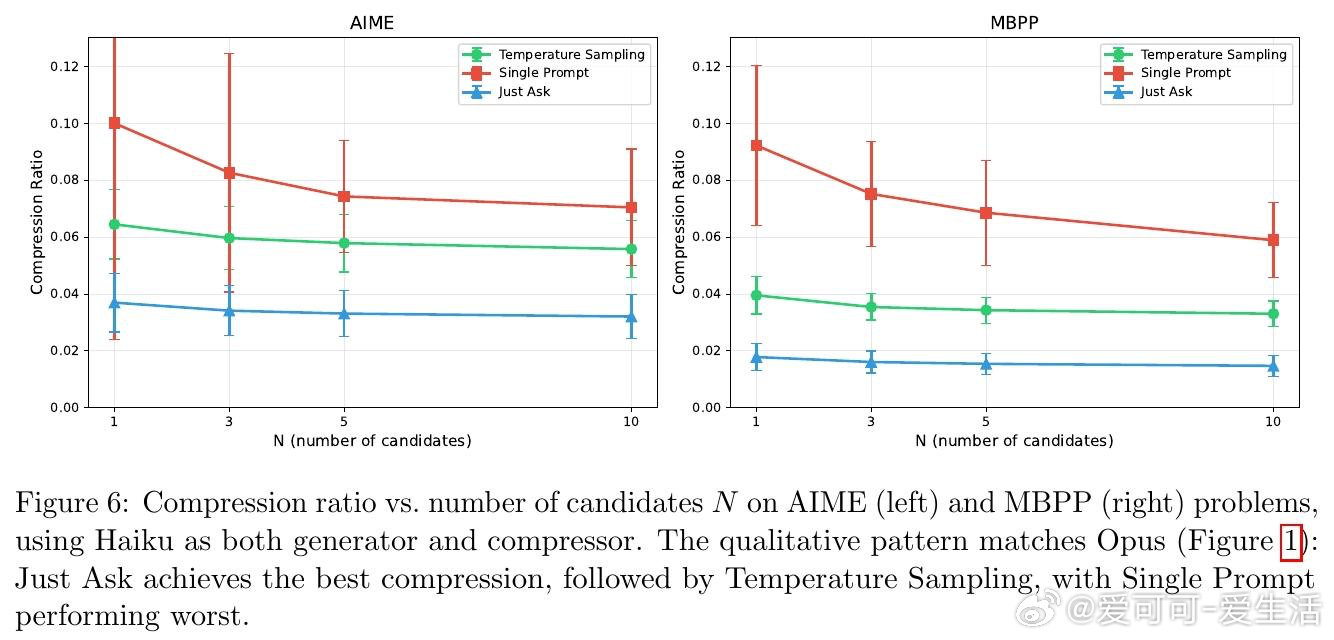

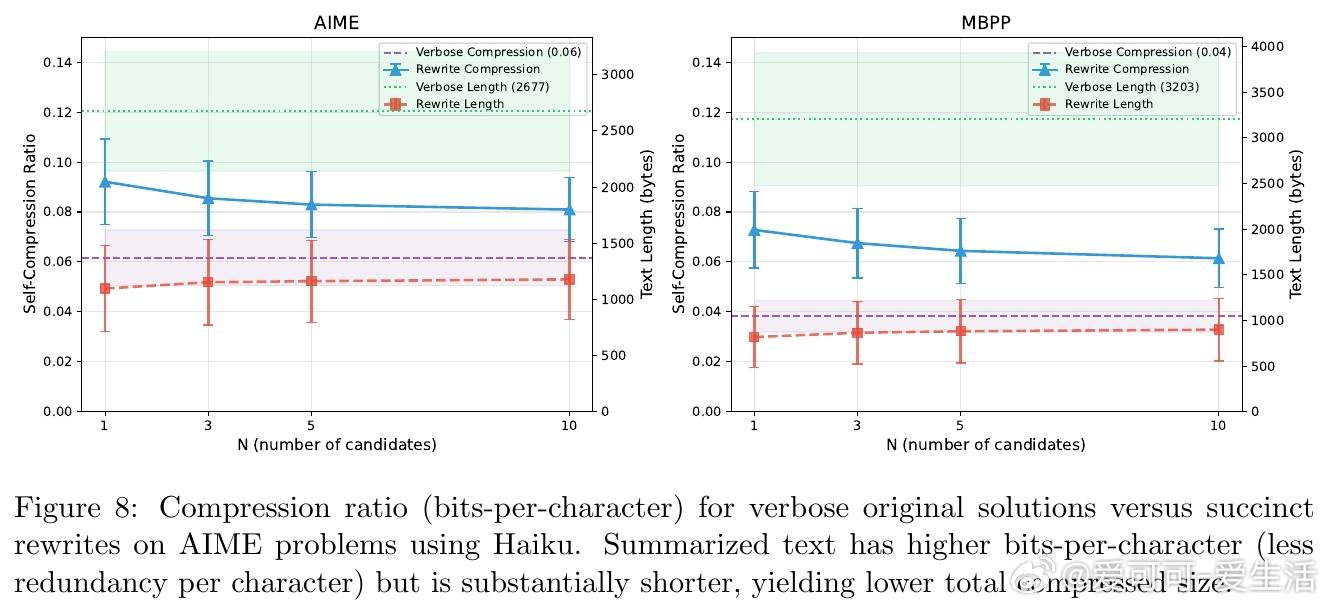

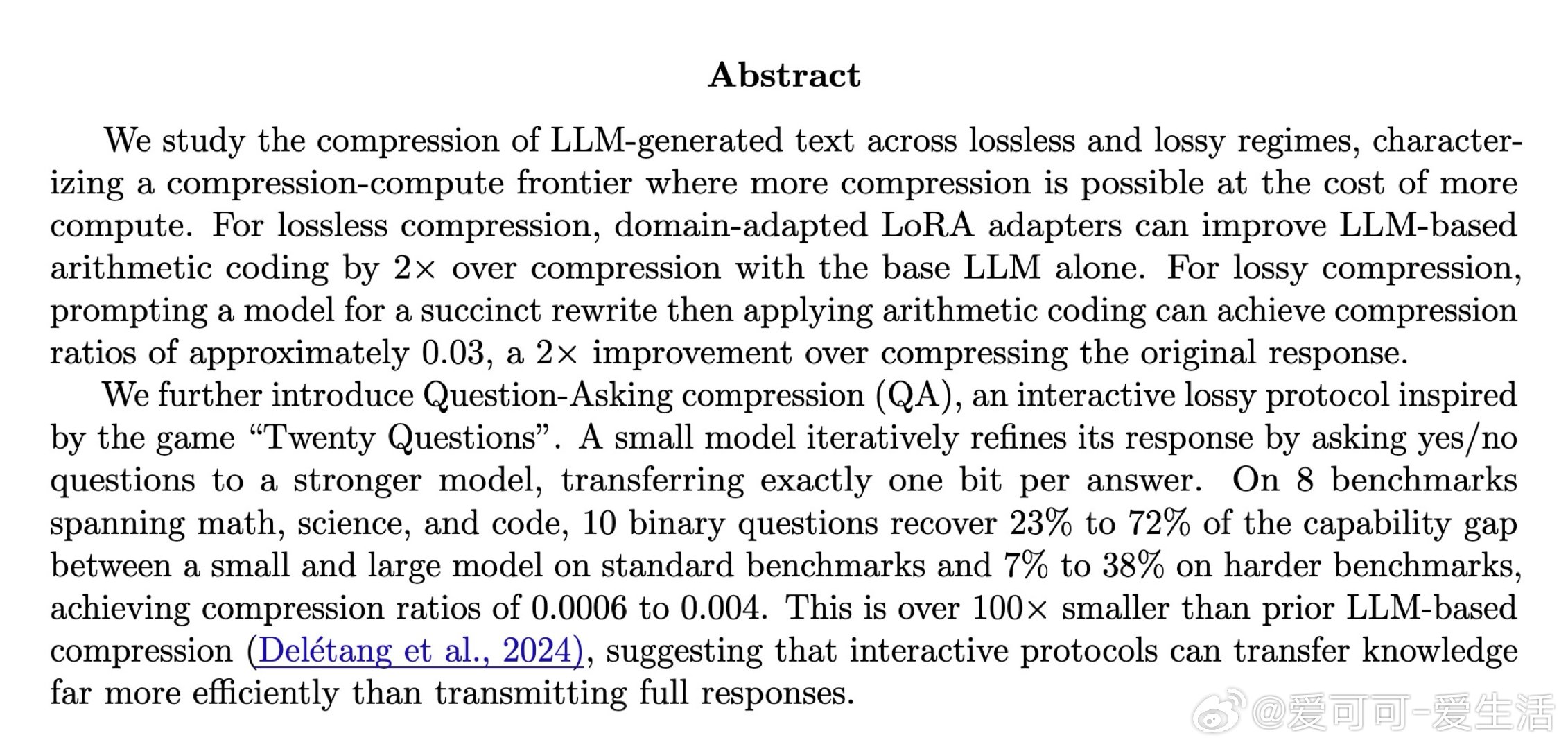

本文的核心洞见是:把"压缩文本"重新看作"压缩知识获取过程"。由此,用二元问答代替内容传输这一关键操作使问题得以解开——小模型向大模型提问,大模型每次仅回传一个比特(是/否),接收方凭借10个比特即可恢复23%至72%的能力差距,压缩比达0.0006,比此前最优方案低100倍以上。

这项工作真正留下的遗产是:证明了交互协议在知识压缩上存在远超静态编码的信息传输效率上限,为模型间协作通信开辟了新的理论空间。它为后来者打开的新门是:将"二十个问题"式的交互范式引入AI系统安全(出口带宽限制)与知识蒸馏场景。但尚未跨过的门槛是:小模型提问质量本身成为瓶颈,竞赛数学等强推理任务对二元问答格式几乎免疫,开放生成任务的有效性仍完全未知。

arxiv.org/abs/2604.02343 机器学习 人工智能 论文 AI创造营