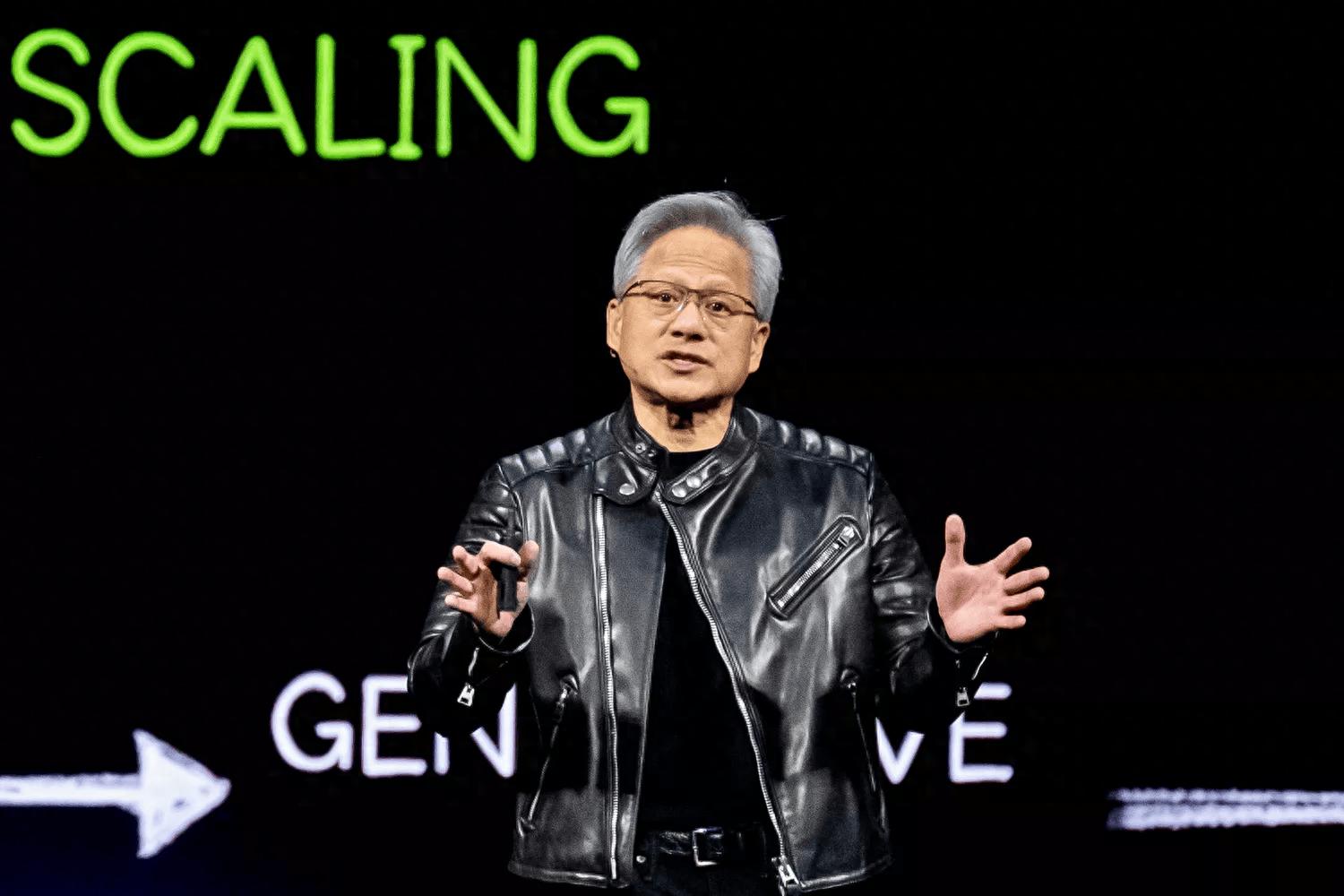

最近科技圈都在好奇,为什么英伟达能像卖白菜一样从容接下巨量AI算力大单?很多人以为他们单纯赢在硬件性能,但在最近的深度分享中,黄仁勋把话挑明了:真正的杀手锏其实藏在底层的代码里。接下来我们将深入解码,看他们是如何一步步挖出这道“万亿美金护城河”的。

这得先从英伟达对整个计算系统协同设计的执念说起。

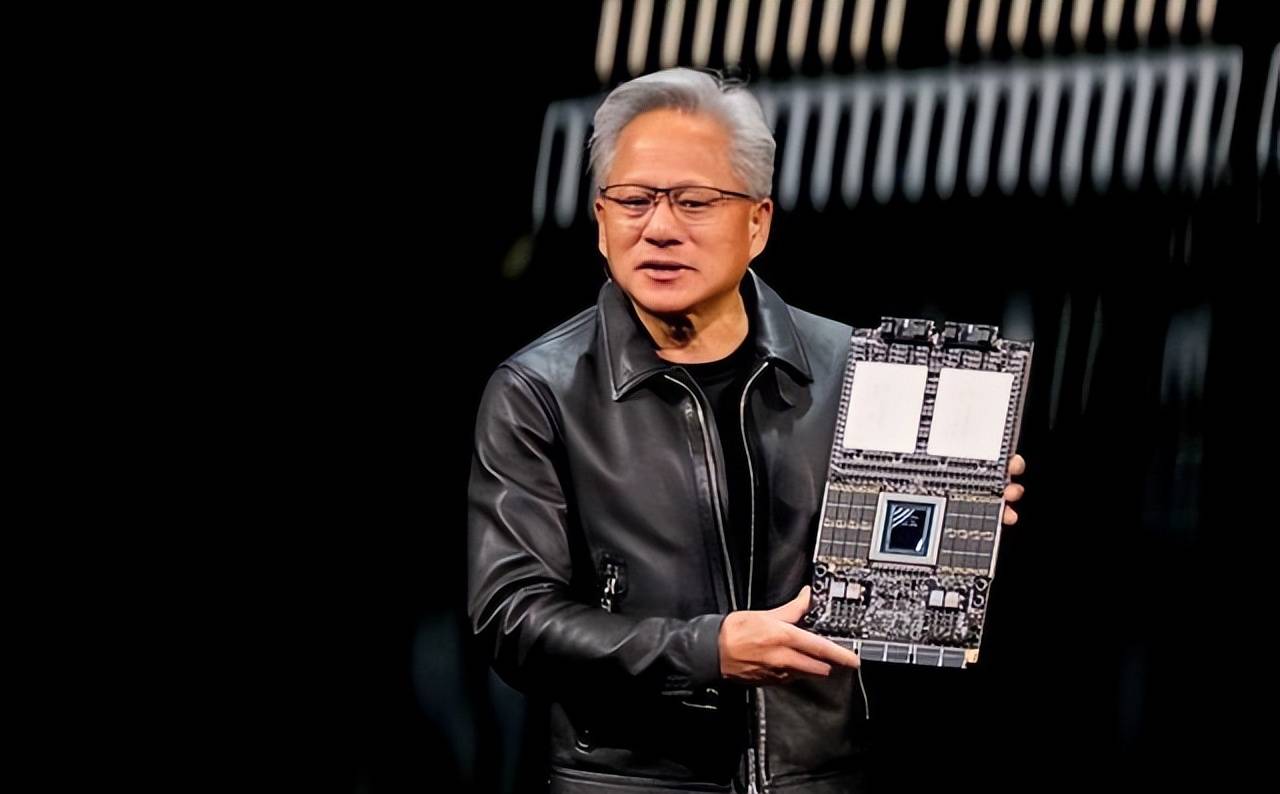

现在英伟达的路线已经从单纯做最好的GPU,扩展到了GPU内存、网络存储、电力、冷却、软件、机架乃至整个数据中心的协同设计。为什么要这么做?因为现在AI的计算规模已经大到单台电脑、单块GPU根本装不下。

如果堆1万台电脑却想要100万倍的速度提升,光靠堆硬件根本做不到,会受阿姆达尔定律限制——如果计算只占总工作量的50%,就算把计算速度提100万倍,整体速度也只能翻一倍。这种分布式计算里,CPU、GPU、网络、交换机、负载调度全是瓶颈,是极其复杂的计算机科学问题。

黄仁勋的解决方法是直接拉全栈的专家一起攻坚,他的直属下属有60多人,全是各个领域的顶级专家:内存、CPU、光学、GPU架构、算法设计全都有。他从来不和下属做一对一面谈,所有问题都拉相关的所有人一起讨论,哪怕聊的是冷却或者网络,其他领域的人也可以随时提意见,比如配电能不能支持、内存能不能适配,所有人对齐信息,效率反而更高。

除了这种硬件体系的极致协同,真正筑起这座万亿美金护城河的,是当年那场豪赌CUDA的决策。

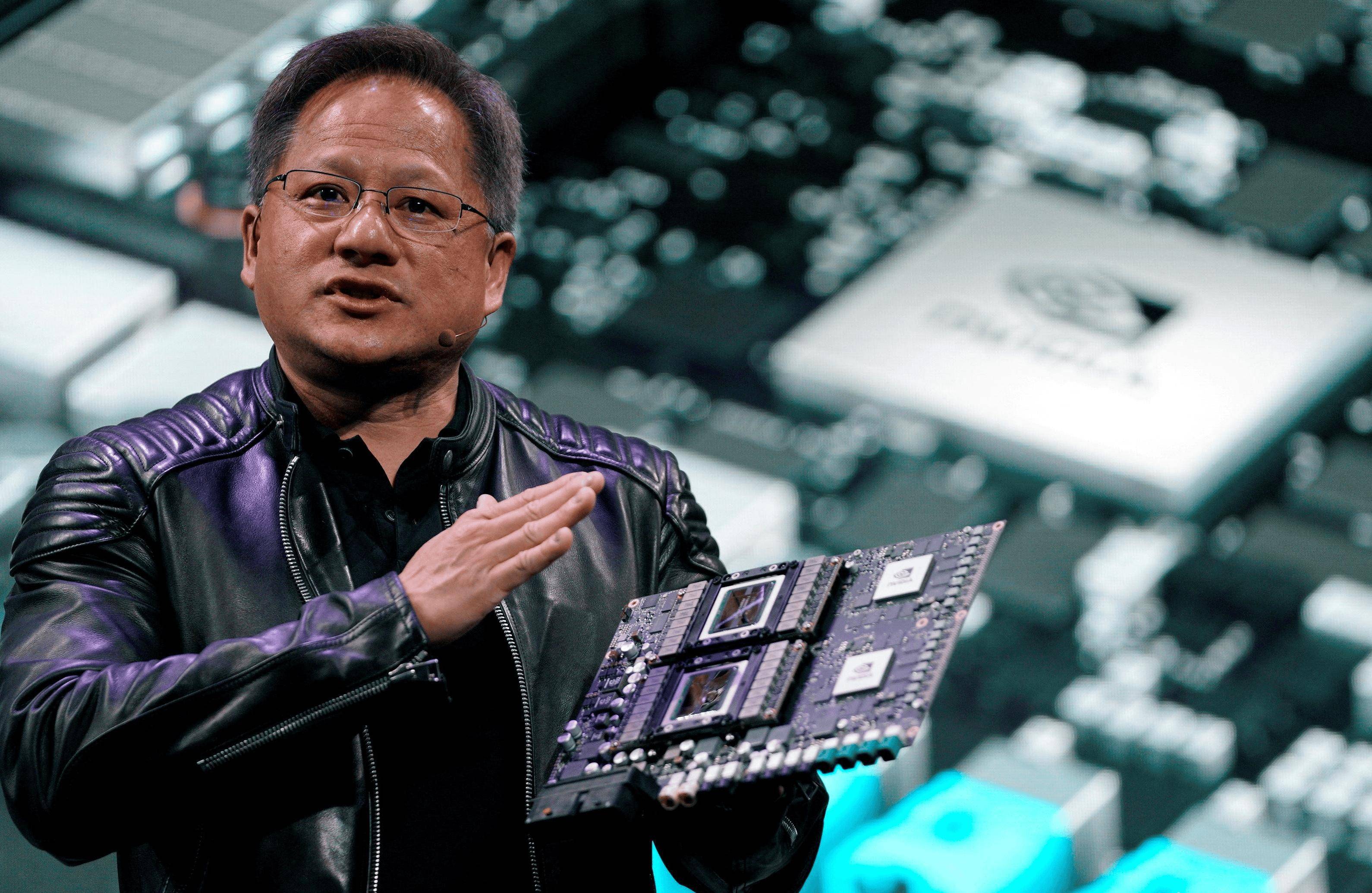

英伟达最早是做游戏GPU的加速器公司,但加速器的问题是应用场景太窄,市场规模限制了研发投入,长远来看没法真正做起来。要做通用的加速计算,又会削弱本身的专业化优势,黄仁勋团队走了一条中间路线:先做可编程像素着色器,再给着色器加符合标准的FP32,一步步往通用计算走,最终催生了CUDA。

当时把CUDA装进消费级GeForce显卡的决策,差点把公司拖死。因为CUDA大幅增加了GPU的成本,但游戏玩家不会为这个功能多付钱,直接吞噬了公司所有毛利。当时英伟达市值大概80亿美元,推出CUDA后直接跌到了15亿美元,在低谷待了很久才慢慢爬回来。

为什么要做这个决定?因为黄仁勋清楚,一个计算架构能不能成,核心看装机量。X86架构不算最优雅,但装机量够大就是能活下来,其他设计得再好的RISC架构大多都死了。

当时GeForce每年能卖几百万块,把CUDA装进去,哪怕消费者不用,也能快速堆起装机量。团队一边给大学送设备、写书开课推CUDA,一边死扛成本压力,最终GeForce把CUDA送到了全球的研究人员、科学家手里,很多人本身就是游戏玩家,自己用GeForce搭机群做研究,最终CUDA成了AI时代的基础设施,也成了英伟达最重要的基石。

靠着这些坚实的装机量基石,英伟达的AI芯片彻底迎来了爆发,因为背后是庞大的算力渴求。

黄仁勋总结了AI发展的四大缩放定律:首先是预训练缩放,之前行业担心高质量人类数据用完了AI就没法再进化,其实根本不用担心。人类交流的大部分内容本身就是合成的,现在AI已经能对真实数据增强、合成,生成海量训练数据,未来训练数据会越来越多,最终训练的限制不会是数据,而是算力。

然后是后训练缩放,接着是推理缩放:之前很多人说推理简单,会是小芯片的市场,甚至会平庸化。黄仁勋一直不认同这个判断,推理本质是思考,思考比阅读难多了。预训练相当于读书记忆找规律,推理是要处理未知问题、拆解问题、规划搜索,怎么可能不耗算力?现在事实也证明,推理的算力消耗比预想的大得多。

第四个是智能体缩放定律:未来的AI系统不会是单个大模型,会衍生出大量子智能体,相当于AI的“乘法”,可以按需快速扩展。

这四个缩放定律是循环的:智能体产生的优质数据回到预训练环节,模型记住并泛化,后训练微调,推理增强,再投入应用,整个循环一直转,最终智能的缩放只取决于算力。不过做硬件要预判两三年后的技术走向,AI模型架构每六个月就更新一次,硬件却要三年迭代一次,必须提前布局。

英伟达的方法是一边自己做基础研究和应用研究,建模型摸第一手需求,一边跟全球所有AI公司合作,听全行业的需求,再做灵活的架构,兼顾专业化加速和通用适应性,CUDA现在已经更新到13.2版本,能快速跟上算法的变化。

这种对算力底层的强大掌控力,甚至也自然而然地反哺了他们最初卖游戏芯片的“老本行”。

作为靠游戏显卡起家的公司,英伟达的GeForce系列至今还是很多玩家认识英伟达的第一渠道。针对最近玩家对DLSS5的争议,黄仁勋表示完全理解大家怕AI把游戏做成“AI垃圾”的顾虑。

但DLSS5是受3D几何、材质、艺术家的创作意图严格约束的,只会增强画面,不会改动艺术家原本的设计。未来DLSS5还会支持自定义风格,比如做成卡通渲染效果,本质是把AI工具交到艺术家手里,帮他们创作出更好的作品,玩家完全不用担心。

他心中最有影响力的游戏是《毁灭战士》,开启了3D游戏时代,让个人电脑从办公工具变成了游戏设备。

从早期的游戏玩家到如今顶尖的AI科学家,无处不在的CUDA装机量,最终汇聚成了他们难以被追赶的核心底牌。

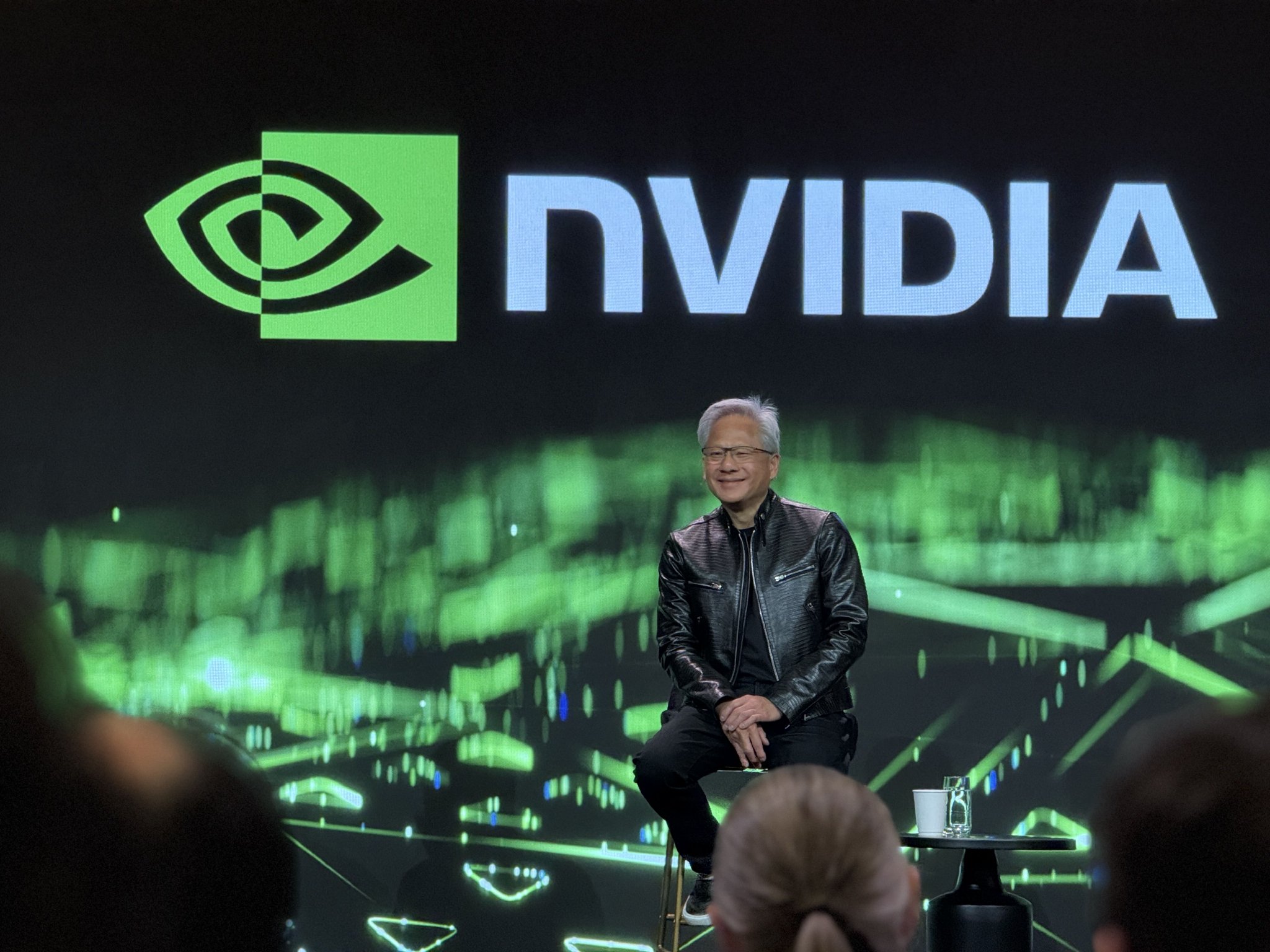

黄仁勋说英伟达最大的护城河是CUDA的装机量。CUDA不是靠三个人做起来的,是4.3万名员工持续20年迭代,还有数百万开发者信任英伟达会一直维护更新,愿意把自己的软件建在CUDA之上,堆起了极高的软件生态壁垒。

现在开发者用CUDA开发,不仅能获得10倍的性能提升,还能触达几亿台设备,覆盖所有云厂商、所有行业、所有国家,这个优势是其他架构追不上的。第二个优势是生态的广度:CUDA架构不仅在云端、企业级超算里,还在汽车、机器人、卫星、太空里,覆盖了几乎所有计算场景。

现在英伟达的计算单元已经从单个GPU,变成了机群、整个AI工厂,未来的目标是做行星级别的计算系统。对于未来的市值,黄仁勋觉得达到3万亿美元是必然的。

因为整个计算范式正在从基于检索的文件系统,转向基于生成的AI计算系统,需要的算力比以前多得多。而且以前的计算机是仓库,现在的AI计算机是工厂,直接生产有价值的token,能产生收入和利润。

未来全球GDP中用于计算的比例会比现在高100倍,英伟达的增长空间是非常大的。现在大家很难想象,是因为英伟达做的大部分市场以前根本不存在,不是抢别人的份额,而是创造新的市场。

守着如此庞大的护城河与广阔的增量市场,这位掌舵人需要承受的压力同样也是常人难以想象的。

作为全球市值最高公司的CEO,黄仁勋要面对的压力非常大:国家的技术安全、供应链的稳定、投资者的收益、上下游伙伴的业务,全压在他身上。他处理压力的方法很简单:先把问题拆解,分析情况、变化、难点,找到可以落地的解决方法,要么自己做,要么交给合适的人做。

只要把所有可能有风险的事都通知到能解决的人,该推进的都在推进,就可以安心睡觉了。遇到低谷的时候,除了拆解问题,还要学会遗忘,不要背着过去的挫折、尴尬、羞辱往前走,把注意力放在未来的机会上。

哪怕现在已经非常成功,他依然保持着谦逊:很多工作都是公开做的,犯错了所有人都能看到,自然会被打击到谦卑。他跟团队沟通从来不是直接下命令,而是把自己的推理过程一步步展示出来,大家可以反对某一步的推理,一起调整方向,相当于集体搜索最优路径。

无论外界怎么疯狂卷硬件,只要全球的千万开发者还深深依赖着这套生态,这道护城河就依然稳如泰山。在这个把顶级AI芯片当白菜卖的大航海时代,算力硬件总有被对手拉近差距的一天,但真正能笑到最后的,永远是那个手握底层入场券、让全行业都踩在自己修好的高速公路上狂奔的人。