【热点评述】超越人类智能的人工智能(AI)系统的探索到了一个转折点,是支持还是阻止呢?

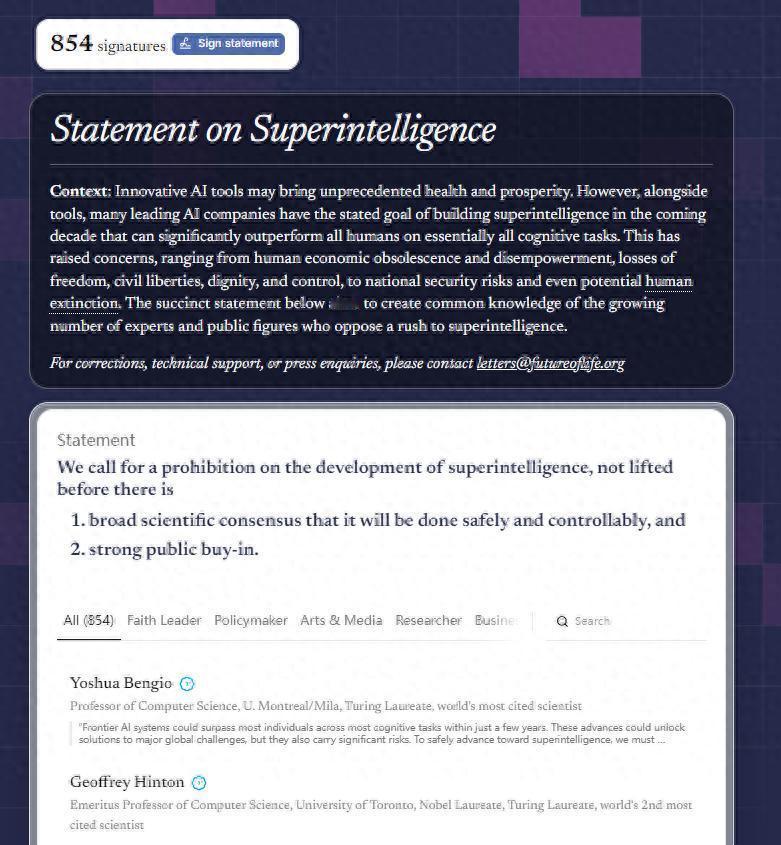

财联社10月22日讯(编辑 黄君芝)包括苹果联合创始人史蒂夫·沃茲尼克(Steve Wozniak)和维珍集团董事长理查·布兰森(Richard Branson)在内的800多名知名人士,近日签署了一份公开声明,要求立即停止超级智能的开发。

这个联合声明警告称,超越人类智能的人工智能(AI)系统带来了从经济崩溃到人类灭绝的风险。

该声明警告说:“超级智能的前景已经引起了人们的关注,其影响从人类经济的落伍和权力的剥夺,自由、公民权力、尊严和控制权的丧失,到国家安全风险,甚至可能导致人类灭绝。”

加州大学伯克利分校(UC Berkeley)的Stuart Russell是一位领先的人工智能安全研究员,多年来一直在对超级智能发出警告,他帮助组织了这项工作。根据他之前的研究,挑战不在于人类能否建立超级智能系统,而是一旦它们存在,人类能否控制它们。

所以问题的焦点就在于,人类能研究出不断创新的超级人工智能系统,但关键在于人类能创造出来,是否有能力控制它们?如果超级人工智能失控了了,那么,人类最终将被超级人工智能所控制,这将是人类在创造力领域发挥所带来的最严重、最恐怖的“异化”现象,人类极可能会被毁灭与自己所创造出来的超级人工智能的成果。

正当Meta将其人工智能部门更名为“Meta超级智能实验室”(Meta Superintelligence Labs)时,出现了这一严厉的声明,这声明不仅仅是一个重要的警告,而且,还涉及到各国政府是否继续支持资金投入到超级人工智能的研究领域。比如,眼下,在美国,OpenAI和马斯克(Elon Musk)的xAI已经陷入了一场越来越公开的竞赛,看谁能首先实现人工通用智能。而其它很多企业也在加强对超级人工智能的研究,而这一声明的出现,等同于直接向OpenAI、Meta和其他科技巨头正在大肆鼓吹的AI模型竞赛“泼了一盆冷水”,这会不会成为成为AI行业发展的一个重大转折点?

换一句话说,国际社会会不会听进这一声明的警告,把超级人工智能的进一步探索视为是可能给人类带来巨大的威胁,甚至威胁到人类的存在?

当然,另一种观点认为,该声明是杞人忧天,是夸大超级智能的消极影响的方面,是夸大其破坏力,有一个关键因素必须被充分考虑到:超级人工智能再“超级”也是人类创造出来的,是“人造之物”,而它再具有“超级”智能,也仍是人类创造的,既然是人类创造的,人类就有办法控制它。超级智能的研究和探索在推进,但人类的智慧也在发展,人类仍是超级智能命运的最终决定者,因而,不必为超级人工智能的快速发展感到恐惧。

大家对这问题是怎么看的?