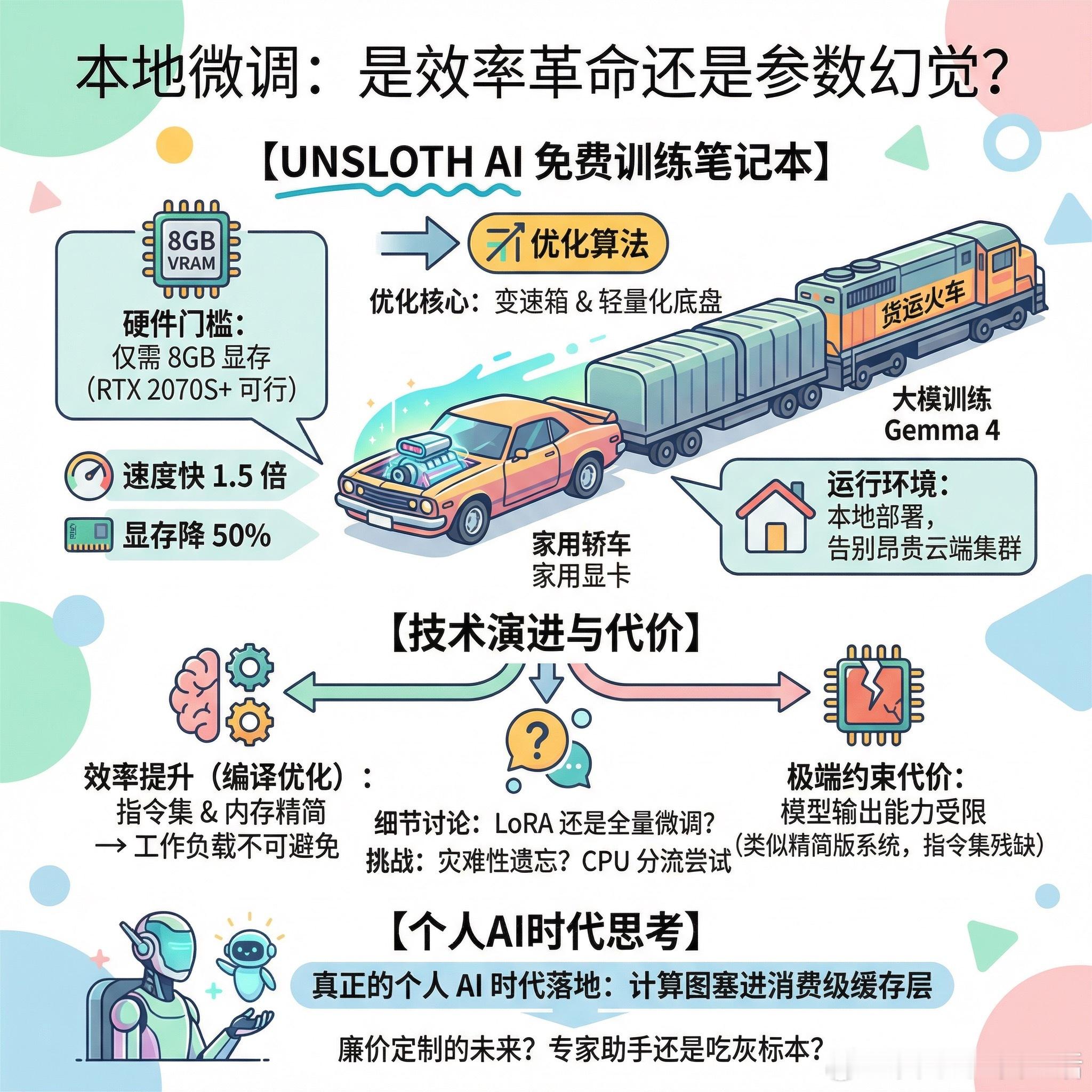

【8GB显存也能训大模型?Unsloth重新定义个人AI硬件边界】

快速阅读:Unsloth AI 发布了针对 Gemma 4 的免费训练笔记本,通过优化算法,让仅需 8GB 显存的家用显卡也能实现比以往快 1.5 倍、显存占用降低 50% 的微调任务。这标志着大模型训练正从昂贵的云端集群向个人本地硬件转移。

---

训练大模型似乎一直是个重型工程,像是在试图用一辆家用轿车去拉动一列货运火车。但 Unsloth AI 现在的做法,更像是给这辆小车换了个超高效的变速箱和轻量化底盘。

只要 8GB VRAM,就能在本地跑起 Gemma 4 的微调。这意味着那些躺在抽屉里的 RTX 2070S 甚至老旧的显卡,突然也有了参与这场智能革命的机会。有网友开玩笑说,这听起来像是在客厅里制造 Skynet 的前奏。

这种效率的提升不仅仅是数字上的变动。当指令集和内存管理变得如此精简,本地运行大模型的工作负载将变得不可避免。硬件能力的边界正在被重新定义。

不过,这种轻量化也有代价。有观点认为,在 8GB 显存的极端约束下,微调出的模型输出能力可能会受到显著限制。这就像是在内存极小的系统上跑精简版操作系统,虽然能动,但指令集总归是残缺的。

大家讨论的热点也散落在细节里:LoRA 还是全量参数微调?如何避免灾难性遗忘?甚至有人在尝试将任务分流到 CPU 上。

这种技术的演进更像是一个编译器的优化过程。当原本需要昂贵算力支撑的计算图,通过重构和压缩,能够塞进消费级硬件的缓存层时,真正的个人 AI 时代才算真正落了地。

现在的疑问是,当我们能用如此廉价的成本去定制模型时,我们究竟会训练出什么?是更懂特定领域的专家,还是仅仅又多了一个堆在硬盘里吃灰的数字标本?

GitHub: github.com/unslothai/unslothGuide: unsloth.ai/docs/models/gemma-4/train