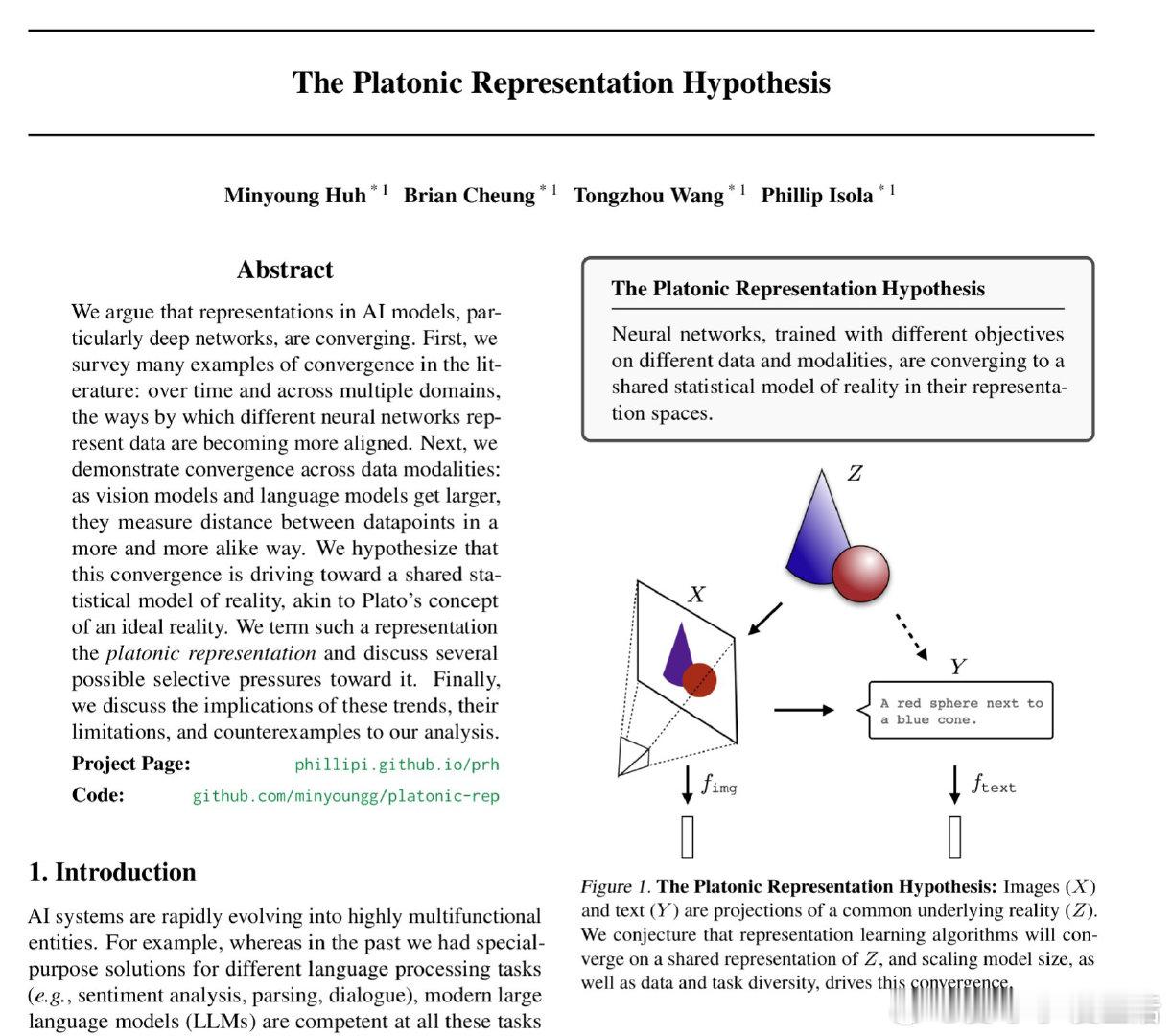

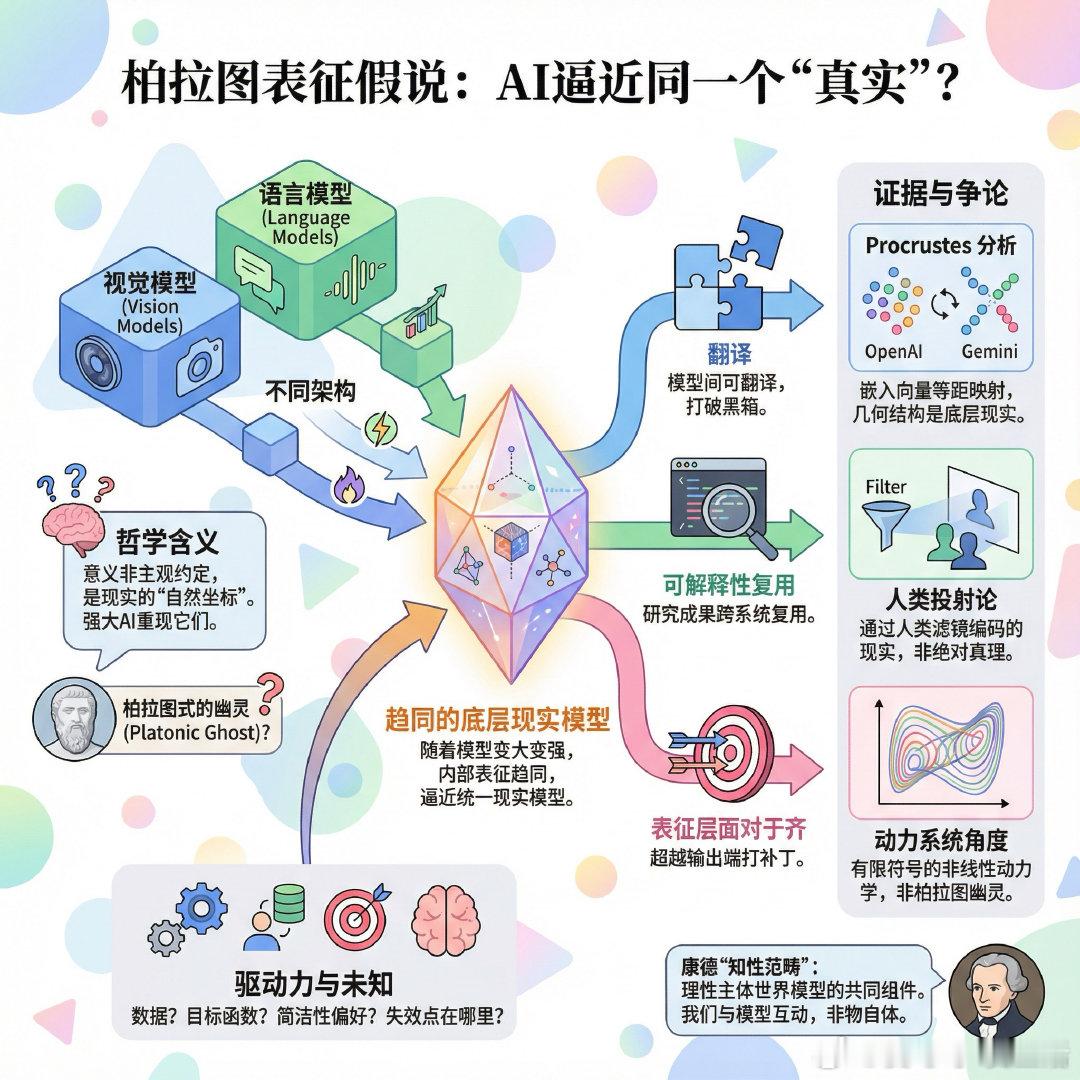

【当AI越来越强大,它们是否正在逼近同一个“真实”?】最近被一个叫“柏拉图表征假说”的概念触动了。核心观点:随着AI模型变得越来越大、越来越强,它们的内部表征正在趋同。视觉模型、语言模型、不同架构——它们似乎都在逐渐逼近同一个底层的现实模型。如果这个假说成立,意义深远:我们可以在模型之间进行“翻译”,而不是把每个模型当作封闭的黑箱;可解释性的研究成果可以跨系统复用;甚至可以在表征层面实现对齐,而不仅仅是在输出端打补丁。更让人细思极恐的是哲学层面的含义:也许“意义”并非人类的主观约定,而是现实本身存在某种“自然坐标”,足够强大的学习者终将重新发现它们。有人指出,上个月他发现OpenAI和Gemini的嵌入向量在同一组文本锚点上存在等距映射——用Procrustes分析得到了一个干净的旋转变换。几何结构就是底层现实,所有形式不过是表象。AI并非在发明新东西,而是在揭示一直存在的东西。也有人提出不同看法:这种“趋同”并非客观真理的投影,而是人类集体意识的投射——通过人类滤镜编码的现实。不是绝对真理,而是“真理对人类而言的样子”。还有人从动力系统角度解释:语言本质上是对声音的压缩表征,映射到相空间后,轨迹模式相似是因为它们反映了词语所捕捉的测量和模式。这不是柏拉图式的幽灵,而是有限符号的非线性动力学。无论哪种解释,一个问题值得深思:是什么在驱动这种趋同?是数据、目标函数,还是某种深层的简洁性偏好?它又会在哪里失效?也许牛顿没有发现万有引力,迟早也会有人发现。模型可能已经推导出了人类尚未明确表达的模式。这让我想起康德的“知性范畴”:任何理性主体的世界模型都会有某些特定的共同组件。我们无法感知物自体,只能与我们的世界模型互动。x.com/marouane5status/2008089151489425624